دیپ لرنینگ، یادگیری عمیق (Deep Learning) چیست؟

دیپ لرنینگ (Deep Learning)، شاخهای پیشرفته از هوش مصنوعی است که با الهام از ساختار مغز انسان، شبکههای عصبی عمیق را برای تحلیل حجم عظیمی از دادهها به کار میگیرد؛ از تشخیص چهره و ترجمهٔ خودکار گرفته تا رانندگی خودران، این فناوری تحولآفرین قلب تپندهٔ بسیاری از نوآوریهای دیجیتال امروز است. اگر میخواهید بدانید دیپ لرنینگ چگونه به کسبوکارها قدرت پیشبینی دقیق، بهینهسازی فرایندها و خلق تجربهٔ کاربری هوشمند میدهد، در ادامه همراه ما باشید تا با مفاهیم، کاربردها و مزیتهای رقابتی یادگیری عمیق بیشتر آشنا شوید.

مفاهیم دیپ لرنینگ

دیپ لرنینگ به زبان ساده

دیپ لرنینگ در پایتون

الگوریتم دیپ لرنینگ

آموزش دیپ لرنینگ

پروژه دیپ لرنینگ

تعریف دیپ لرنینگ

تاریخچه دیپ لرنینگ

تکنولوژی دیپ لرنینگ

جزوه دیپ لرنینگ

دوره دیپ لرنینگ

کتاب دیپ لرنینگ

دیپ لرنینگ و ماشین لرنینگ

معنی دیپ لرنینگ

هوش مصنوعی و دیپ لرنینگ

تفاوت ماشین لرنینگ و دیپ لرنینگ

فرق ماشین لرنینگ و دیپ لرنینگ

در این مقاله به موضوع مهم «یادگیری عمیق» یا Deep Learning خواهیم پـرداخت. با یـکدیگر خواهیم آمـوخت که یادگیری عمیق چیست و سپس کـمی در مـورد تاریــخچه دیپ لرنینگ به بحث خواهیم نشست. در بخش بعدی، به تفاوت یادگیری ماشین و یادگیری عمیق و همینطور شبکههای عصبی خواهیم پرداخت. سپس درمورد کاربردهای یادگیری عمیق چندین مورد را با هم بررسی خواهیم کرد و در پایان به برخی نرمافزارها و سختافزارهای موردنیاز درمورد دیپ لرنینگ خواهیم پرداخت.

مقدمه ای به یادگیری عمیق (دیپ لرنینگ)

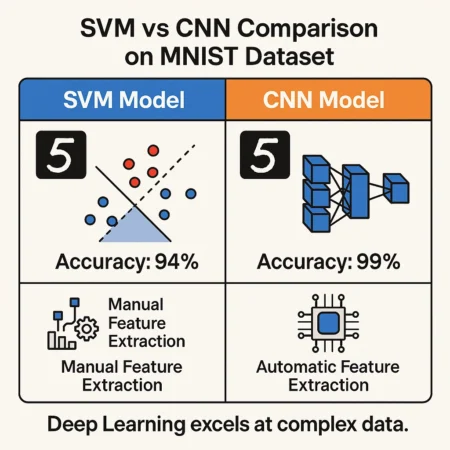

دیپ لرنینگ طی یک دهه گذشته، حوزه هوش مصنوعی (AI) را متحول کرده و موجب پیشرفتهای شگرفی در زمینههایی مانند بینایی کامپیوتر، پردازش زبان طبیعی (NLP)، تشخیصهای پزشکی و رانندگی خودران شده است. در اصل، دیپ لرنینگ شامل آموزش شبکههای عصبی مصنوعی—سیستمهایی که به طور آزاد از مغز انسان الهام گرفتهاند—برای کشف خودکار نمایشهای داده است که برای وظایفی مانند دستهبندی، رگرسیون و تولید داده کاربرد دارند. برخلاف رویکردهای سنتی «یادگیری ماشین سطحی» که به ویژگیهای دستساز و مدلهای نسبتاً ساده تکیه دارند، دیپ لرنینگ از لایههای متعدد پردازشی برای یادگیری انتزاعات سلسلهمراتبی و سطح بالایی به طور مستقیم از داده خام استفاده میکند. این توانایی، رسانهای برای پیشرفت سریع در تحقیقات هوش مصنوعی و کاربردهای دنیای واقعی بوده و دیپ لرنینگ را به یک فناوری بنیادی در عصر دیجیتال مدرن تبدیل کرده است. در این نوشتار، سفر دیپ لرنینگ را از ریشههای مفهومی اولیه تا معماریهای پیشرفته امروزی بررسی خواهیم کرد. به مبانی ریاضی شبکههای عصبی میپردازیم، خانوادههای اصلی مدلها که این حوزه را تعریف کردهاند مرور میکنیم، تکنیکهای کلیدی آموزش را بررسی خواهیم کرد و کاربردهای برجسته این فناوری در صنایع گوناگون را معرفی مینماییم. همچنین به چالشهای عملی در پیادهسازی سیستمهای دیپ لرنینگ—مانند نیاز به داده، هزینههای محاسباتی، تفسیرپذیری و ملاحظات اخلاقی—خواهیم پرداخت و نگاهی به روندهای نوظهور خواهیم داشت که آینده هوش مصنوعی را رقم خواهند زد. چه شما مبتدی باشید و به دنبال دیدی کلی هستید یا یک متخصص که میخواهید دانش خود را عمیقتر کنید، این پست تلاش دارد تا هم از لحاظ گستره و هم عمق، تصویری کامل از موضوع دیپ لرنینگ ارائه دهد.

دیپ لرنینگ (یادگیری عمیق) چیست؟

یادگیری عمیق (Deep Learning) شاخهای پیشرفته از یادگیری ماشین است که بر پایهٔ ساختارهای چندلایهٔ شبکههای عصبی مصنوعی (Artificial Neural Networks) کار میکند. در این روش، مدلها بهجای تکیه بر ویژگیهای دستساز، توانایی استخراج ویژگیها و الگوهای پیچیده را از دادههای خام میآموزند. بههمین دلیل به این روش «جعبه سیاه» نیز گفته میشود: زیرا با وجود عملکرد بسیار قوی، تفسیر داخلی آن برای انسان دشوار است.

برای کسب اطلاعات بیشتر و درک مفهوم عمیقتر درباره دانشنامه یادگیری عمیق ویدیوی 5 دقیقهی در زیر برای شما کاربران عزیز آماده کردهایم. بعد از مشاهده ویدیو نظرات و پیشنهاد خود را در دیدگاه زیر بنویسید. تا جواب کنجکاوی علم خودتان را دریافت کنید.

چرا یادگیری عمیق (دیپ لرنینگ) اهمیت دارد؟

قابلیت یادگیری از دادههای بزرگ

با افزایش حجم و تنوع دادهها در دنیای امروز، روشهای سنتی یادگیری ماشین (مثلاً درخت تصمیم یا SVM) بهتنهایی نمیتوانند تمام الگوهای پنهان را بیابند. یادگیری عمیق با استفاده از لایههای متعدد، میتواند الگوهای سطح بالا را از دادههای خام استخراج کند.

عملکرد بینظیر در مسائل پیچیده

تشخیص تصویر: مدلهای CNN (شبکههای عصبی پیچشی) در تشخیص اشیاء و طبقهبندی تصاویر دقتی فراتر از روشهای پیشین دارند.

پردازش زبان طبیعی: معماریهای مبتنی بر Transformers مانند BERT و GPT توانستهاند در ترجمه، پاسخگویی به سؤال و چتباتها پیشرفت چشمگیری ایجاد کنند.

گفتار و صدا: با استفاده از RNN و LSTM، سیستمهای تشخیص گفتار اکنون بهصورت بلادرنگ کلمات را از فایل صوتی استخراج میکنند.

انعطافپذیری و توسعهپذیری

بسته به کاربرد، میتوان معماریهای متنوعی مانند شبکههای خودرمزگذار (Autoencoder)، GAN (شبکههای مولد تخاصمی) و شبکههای گراف (GNN) را پیادهسازی کرد.

تاریخچه یادگیری عمیق (دیپ لرنینگ)

دهههای ۱۹۴۰–۱۹۵۰: آغاز مدلهای عصبی

مککلالاچ و پیتس (۱۹۴۳): اولین مدل رسمی یک نورون مصنوعی را معرفی کردند و نشان دادند که واحدهای باینری با آستانه میتوانند در اصل هر تابع بولی را محاسبه کنند.

قانون یادگیری هِب (۱۹۴۹): دونالد هِب قانون «نورونهایی که با هم شلیک میکنند، با هم مرتبط میشوند» را پیشنهاد داد که پایه و اساس الگوریتمهای یادگیری بعدی شد.

دههٔ ۱۹۶۰: پرسپترونها و خوشبینی اوّلیه

پرسپترونِ روزنبلَت (۱۹۵۸–۱۹۶۲): اولین پیادهسازی سختافزاری یک پرسپترون تکلایه را ساخت که قادر به انجام وظایف طبقهبندی دودویی بود.

نقد مینسکی و پَپِرت (۱۹۶۹): محدودیتهای شبکههای تکلایه (مانند ناتوانی در حل مسئله XOR) را برجسته کردند که منجر به کاهش بودجه و اولین «زمستان هوش مصنوعی» شد.

دهههای ۱۹۷۰–۱۹۸۰: پسانتشار خطا و بازگشت علاقه

الگوریتم پسانتشار خطا: اگرچه پایههای ریاضی آن توسط پژوهشگرانی مانند ورباس (۱۹۷۴) و پارکر (۱۹۸۲) توسعه یافت، روملهارت، هینتون و ویلیامز (۱۹۸۶) بودند که آن را رایج کردند و امکان آموزش مؤثر شبکههای چندلایه را فراهم ساختند.

کاربردها: آزمایشهای اولیه شبکههای چندلایه را برای تشخیص نویسهها و وظایف الگوپذیری کوچک مقیاس به کار بردند.

دههٔ ۱۹۹۰: روشهای هستهای و ماشینهای بردار پشتیبان

ظهور SVM و روشهای هستهای: منابع محاسباتی محدود و مجموعهدادههای کوچک باعث شد پژوهشگران به روشهای مبتنی بر هسته مانند ماشینهای بردار پشتیبان روی بیاورند که از بسیاری از مدلهای شبکه عصبی آن دوره پیشی گرفتند.

دههٔ ۲۰۰۰: ظهور معماریهای عمیق

شبکههای باور عمیق (۲۰۰۶): هینتون و همکارانش پیشآموزش بدوننظارت از ماشینهای بولتزمن محدود شده را معرفی کردند و معماریهای عمیق را احیا کردند.

تابع فعالسازی ReLU (۲۰۱۰): واحد خطی اصلاحشده، تابع فعالسازی ساده اما قدرتمندی ارائه داد که مشکل ناپدید شدن گرادیان را کاهش داد.

دههٔ ۲۰۱۰ تاکنون: انفجار یادگیری عمیق

آلکسنت (۲۰۱۲): قدرت شبکههای عصبی پیچشی را بر روی مجموعهداده ImageNet نشان داد و منجر به افزایش شدید پژوهشهای شتابگرفته با GPU در یادگیری عمیق شد.

معماریهای مدرن: ترنسفورمرها، GANها و شبکههای پیچشی کارآمد مرزهای پردازش دیداری، زبانی و تولید مدلهای مولد را گسترش دادهاند.

این تاریخچهٔ غنی نشان میدهد که یادگیری عمیق نتیجهٔ دههها بینش نظری، نوآوری مهندسی و تکامل تدریجی است.

معماریهای رایج در یادگیری عمیق (دیپ لرنینگ)

شبکه عصبی پیچشی (CNN)

مناسب برای دادههای تصویری؛ از لایههای کانولوشن، pooling و batch normalization تشکیل شده است.

شبکه عصبی بازگشتی (RNN) و مشتقات آن (LSTM, GRU)

مناسب برای دادههای توالیدار مانند متن و گفتار؛ با ذخیرهٔ حالت (state) در طول توالی کار میکنند.

شبکههای مولد تخاصمی (GAN)

متشکل از دو شبکه: مولد (Generator) و تفکیککننده (Discriminator) که در یک بازی دوطرفه به بهبود کیفیت نمونههای تولیدی میپردازند.

معماریهای مبتنی بر توجه (Attention)

قلب مدلهای Transformer را تشکیل میدهند و با وزندهی به بخشهای مهم ورودی، درک بهتری از متون طولانی و تصاویر پیچیده ایجاد میکنند..

(دیپ لرنینگ) یادگیری عمیق چگونه کار میکند؟

یک مدل یادگیری عمیق برای تجزیهوتحلیل مداوم دادهها با ساختار منطقی شبیه به نتیجهگیری انسان طراحی شده است. برای دستیابی به این هدف، برنامههای یادگیریعمیق از یک ساختار لایهای الگوریتمها به نام شبکههای عصبی مصنوعی استفاده میکنند. طراحی یک شبکه عصبی مصنوعی با الهام از شبکه عصبی بیولوژیکی مغز انسان انجام شده است و منجر به نوعی فرایند یادگیری میشود که توانایی آن بسیار بیشتر از مدلهای استاندارد یادگیری ماشین است. پیشبینی این موضوع که مدل یادگیری عمیق نتیجۀ نادرستی را بهدست آورده یا خیر بسیار سخت است. مانند سایر نمونههای هوش مصنوعی، یادگیریعمیق به آموزشهای زیادی احتیاج دارد تا فرایند یادگیری را به طور صحیح انجام دهد. اما وقتی این مدل یادگیری عملکردی آنطور که در نظر گرفتهشده عمل میکند، غالباً از آن بهعنوان یک شگفتی علمی یاد میکنند و آن را بخش اصلی هوش مصنوعی واقعی میدانند.

یک مثال عالی از یادگیریعمیق AlphaGo «آلفا گو» گوگل است. گوگل یک برنامۀ کامپیوتری با شبکۀ عصبی اختصاصی برای خود ایجاد کرد که بازی تختهای انتزاعی به نامGo» » را فراگرفت، دلیل شهرت این بازی تیزبینی و بصیرت آن است. مدل این یادگیری «آلفا گو» با بازی در برابر بازیکنان حرفهای آموخت چگونه در سطحی که قبلاً در هوش مصنوعی دیده نشده بود، بازی کند و بدون اینکه به آن گفته شود چه زمانی باید یک حرکت خاص را انجام دهد، این کار را انجام دهد (همانطور که یک مدل استاندارد یادگیری ماشین نیاز دارد). وقتی «آلفا گو» چندین “استاد” مشهور جهان را در این بازی شکست داد، غوغایی به پا شد. یک ماشین نهتنها میتواند تکنیکهای پیچیده و جنبههای انتزاعی بازی را درک کند، بلکه قادر است تا به یکی از بزرگترین بازیکنان آن تبدیل شود.

تعریفی دیگر از دیپ لرنینگ

دیپ لرنینگ یک حوزه پیشرفته در زمینه هوش مصنوعی است که به توسعه مدلهای یادگیری عمیق مبتنی بر شبکههای عصبی متناوب (Neural Networks) متمرکز است. در این رویکرد، سعی در تقلیل از نیاز به دستهبندیها و ویژگیهای دستی انسانی و همچنین افزایش تواناییها و کارایی مدلها دارد. یکی از ویژگیهای مهم دیپ لرنینگ، امکان یادگیری تأثیرات سلسله مراتبی در دادهها است. این به معنای این است که مدلهای دیپ لرنینگ قادرند ویژگیها و الگوهای پیچیدهتر را از دادهها استخراج کرده و تفسیرات عمیقتری از آنها ارائه دهند. علاوه بر این، دیپ لرنینگ به خوبی در مسائلی مانند تشخیص الگو، ترجمه ماشینی، تصویربرداری، و پردازش زبان طبیعی کاربرد دارد. به دلیل توانمندی در یادگیری از دادههای بزرگ و پیچیده، این رویکرد در سالهای اخیر به سرعت در حوزههای مختلف به کار گرفته میشود. در کل، دیپ لرنینگ به عنوان یک فرآیند یادگیری عمیق، قابلیت تجزیه و تحلیل اطلاعات پیچیده را داراست و در مسائلی که نیاز به درک عمیق و جزئی دادهها است، نقش مهمی ایفا میکند.

دیپ لرنینگ چه نقشی در دنیای امروز و آینده دارد؟

دیپ لرنینگ به عنوان یک حوزه مهم در زمینه هوش مصنوعی، نقش بسیار بزرگ و تاثیرگذاری در دنیای امروز و آینده ایفا میکند. این رویکرد، با بهرهگیری از شبکههای عصبی عمیق، توانسته است در بسیاری از زمینهها از تکنولوژی و خدمات پیشرفته بهرهمند کند. در ادامه، نقش و تاثیر دیپ لرنینگ در دنیای امروز و آینده بررسی میشود. یکی از جوانب مهم دیپ لرنینگ، افزایش کارایی در تشخیص الگوها و پیشبینیها است. این رویکرد بهبود چشمگیری در زمینههای تصویربرداری، پردازش زبان طبیعی، و تحلیل دادههای پیچیده داشته و به دلیل توانایی در یادگیری از دادههای حجیم، به دقت بالا و توانایی تعمیمپذیری فراوان دستیافته است. در کل، دیپ لرنینگ به عنوان یک مبحث فراتر از یادگیری ماشینی در دنیای امروز و آینده اهمیت زیادی دارد. این تکنولوژی، با توانایی در تجزیه و تحلیل دادههای حجیم و پیچیده، در حل چالشهای متنوع اجتماعی، اقتصادی، و علمی نقش کلیدی ایفا میکند و توسعه آینده را به سمت هوش مصنوعی پیش میبرد.

معماریهای کلیدی دیپ لرنینگ

دیپ لرنینگ طی دهه گذشته، معماریهای شبکههای عصبی بسیار جدیدی را با استعارههای مهندسی پیشرفته ایجاد کرده است. در این بخش، به نگاهی جامع از معماریهای کلیدی دیپ لرنینگ که برای انواع دادهها و وظایف ویژه طراحی شدهاند، میپردازیم:

شبکههای عصبی کانولوشنی (Convolutional Neural Networks - CNNs)

این معماریها برای دادههای شبیه به شبکه (مانند تصاویر) بهینه شدهاند و سه لایه مهم دارند:

لایههای کانولوشنی (Convolutional Layers):

با استفاده از فیلترهای قابل یادگیری (کرنلها)، سیگنالهای محلی دادههای اولیه را تشخیص میدهند.

مثلاً فیلترها در سیکلهای ابتدایی نمایندهی لبهها و الگوهای ساده هستند، و در سیکلهای بعدی نمایندهی الگوهای پیچیدهتر مانند چشمها یا چرخها در تصاویر.

لایههای پولینگ (Pooling Layers):

با کاهش ابعاد تصویر (مانند Max Pooling)، مدل را در برابر تغییرات مکانی (مثلاً جابجایی یک شیء در تصویر) مقاوم میکنند.

این امر باعث افزایش کارایی و کاهش محاسبات میشود.

لایههای کاملاً متصل (Fully Connected Layers):

ویژگیهای استخراج شده از لایههای قبلی را با برچسبهای تعریف شده (مانند “سیب”، “ماشین”) مرتبط میکنند.

معماریهای برجسته:

LeNet (1998): اولین CNN معروف برای شناسایی دستنوشتهها.

AlexNet (2012): با معماری عمیقتر و استفاده از GPUها، در مسابقات ImageNet شکستهای نوآورانهای ایجاد کرد.

ResNet (2015): اتصاڵات باقیمانده (Residual Connections) را معرفی کرد تا مشکل گرادیان ناپدید کننده در شبکههای عمیقتر را حل کند.

EfficientNet (2019): با بهینهسازی مقیاسپذیری (Width, Depth, Resolution)، تعادل بین دقت و قدرت محاسباتی را بهبود بخشید.

شبکههای عصبی بازگشتی (Recurrent Neural Networks - RNNs) و نسخههای بهروزشده

این شبکهها سیگنالهای متوالی (مانند جملات یا سیگنالهای زمانی) را با نگهداشتن حالت پنهانی (Hidden State) پردازش میکنند. مثلاً در شناسایی گفتار، حالت پنهانی اطلاعات از کلمات گذشته را حفظ میکند. اما معماری RNNهای سنتی با مشکل گرادیان ناپدیدشونده/انفجاری در دنبالههای بلند (مانند جملات خیلی طولانی) روبهرو هستند. نسخههای زیر این چالش را حل کردند:

LSTM (Long Short-Term Memory):

سردریچهای ورودی (Input Gate)، فراموشی (Forget Gate) و خروجی (Output Gate) را معرفی کرده تا سیستم بتواند اطلاعات مهم را حفظ و بقیه را رها کند.

GRU (Gated Recurrent Unit):

سردریچها را سادهتر کرده (ترکیب Input و Forget Gate به Update Gate) و برای بهینهسازی سرعت استفاده شد.

RNNهای دوسمتی (Bidirectional RNNs):

دنبالهها را در هر دو جهت گذرا میکند تا زمینهی ریکندهتری برای پیشگویی فراهم شود (مثلاً در ترجمهی ماشینی، هم متن سمت راست و چپ جمله در نظر گرفته میشود).

این معماریها در بین 2015-2017 اکثریت چارچوبهای تشخیص گفتار را مانند Google Assistant یا Siri هدایت میکردند.

معماری ترانسفورمر (Transformer Models)

معرفی شده در مقاله “Attention Is All You Need” (2017)، ترانسفورمرها به جای گذر زمانی (Recurrent) بر اساس مکانیزم Attention کار میکنند. این امر به مدل اجازه میدهد وزن هر توکن (مثلاً کلمه در جمله) را براساس اهمیت آن نسبت به سایر توکنها تعیین کند.

اجزاء کلیدی:

مکانیزم توجه چندسری (Multi-Head Attention):

چندین توجه موازی ایجاد میکند که روابط مختلف بین توکنها را تشخیص دهد (مثلاً در جمله “چه کسی به سفر رفته؟”، توجه به “چه” و “کسی” تغییر میکند).

کُد راهاندازی مکانی (Positional Encodings):

ترتیب توکنها (مثلاً اهمیت “آسمان” قبل از “آبی”) را به مدل درس میدهد.

زیز لایههای فیدفوروارد (Feedforward Sublayers):

تغییرات محلی یکتا و پایدارسازی مدل را فعال میکند.

کاربردها:

در زبانهای فارسی و غیره:BERT (2018) برای درک زبان بهتر،GPT series برای تولید متن هوشمند (مانند تولید مقاله 1000 کلمهای در ایران)،RoBERTa برای بهینهشدهی هوشمندتر،T5 برای انواع وظایف NLP (مثل ترجمهی جملات صنعت هوشمند).

اداپتاسیونهای بصری:

Vision Transformers (2020+) با استفاده از تکنیک Patch Embedding، تصاویر را به توکنهای متوالی تبدیل و عملیات توجه را به کار میگیرند. مثلاً در تشخیص عیوب صنعتی در خطوط تولید ایران، توجه به نقاط بحرانی تصویر تقویت میشود.

شبکههای عصبی گرافی (Graph Neural Networks - GNNs)

این معماریها برای دادههای غیرسازمانیافته با ساختار گراف (مانند شبکههای اجتماعی، مولکولها، پایگاههای دانش) به کار میروند.

کاربردها:

تشخیص هوشمند دوستان مشترک در شبکههای اجتماعی ایران،

پیشگویی خواص شیمیایی مواد باسیلهی تحلیل گراف مولکول،

تحلیل ساختارهای اقتصادی در ERPهای صنعتی.

معماریهای برجسته:

GCNs (Graph Convolutional Networks):

فیلترهای کانولوشنی را برای گراف بهینه میکند.

GATs (Graph Attention Networks):

به جای ترکیب بیتفاوت همسایهها، وزنبندی هوشمند براساس اهمیت انجام میدهد.

خودرمزکنندهها (Autoencoders) و مدلهای تولیدی

خودرمزکنندهها (Autoencoders):

معماری دو بخشی (Encoder-Decoder) که داده را فشرده میکند و مجدداً بازسازی میکند.

کاربردها:

تشخیص ناهنجاری در دادههای تولیدی شرکتهای تبریز و اصفهان،

یادگیری نمایشهای مخفی در دادههای صنعت خودرو (مثل تشخیص خرابی قطعه با استفاده از فشردهسازی تصاویر).

ویانها (Variational Autoencoders - VAEs):

چارچوب احتمالی برای یادگیری متغیرهای مخفی (Latent Variables) به کار میبرند.

مثلاً یادگیری توزیع دادههای میکروکنترلرهای صنعتی برای پیشبینی خرابی آنها.

شبکههای غیرمنصفانه تولیدی (Generative Adversarial Networks - GANs):

شامل دو مدل: مربی و داور (Discriminator-Generator).

چالش: پایداری تمرین (مثلاً شبکههای باسواد مانند StyleGAN یا BigGAN برای تولید تصاویر بصری هوشمندانهی صنعتی).

مثال ایرانی:

در صنایع فولاد ایران، VAEها میتوانند الگوهای مخفی خط تولید را یاد بگیرند و GANها نمونههای خرابی مولدهای شده از جرثقیلهای کارخانه را تولید کنند تا آموزش مدلهای کنترل کیفیت را سرعت بدهند.

اهمیت یادگیری عمیق در کسب و کارها: فراتر از یک مزیت رقابتی

یادگیری عمیق (Deep Learning) یک ابزار استراتژیک برای کسبوکارهای مدرن است که با تحلیل هوشمندانه دادهها، مزیت رقابتی ایجاد میکند. اهمیت آن در سه حوزه کلیدی نمایان میشود:

۱. افزایش بهرهوری: با خودکارسازی فرآیندهای پیچیده مانند کنترل کیفیت در تولید یا تشخیص تقلب در امور مالی، هزینهها را کاهش داده و خطای انسانی را به حداقل میرساند.

۲. درک عمیق مشتری: الگوریتمهای دیپ لرنینگ با تحلیل رفتار کاربران، امکان شخصیسازی بینظیر خدمات و محصولات را فراهم میکنند (مانند موتورهای پیشنهادگر) و به درک احساسات مشتریان از طریق تحلیل نظرات کمک میکنند.

۳. نوآوری و پیشبینی: این فناوری به شرکتها قدرت پیشبینی تقاضای بازار، مدیریت بهینه منابع و توسعه محصولات نوآورانه مانند دستیارهای صوتی و ابزارهای هوشمند را میدهد.

در مجموع، یادگیری عمیق از یک فناوری صرف به یک ضرورت برای رشد، بهینهسازی و پیشرو ماندن در بازار تبدیل شده است.

موارد مورد استفاده از دیپ لرنینگ در صنایع چگونه است؟

یادگیری عمیق توانسته به بهبود شرایط، روند کار و بهینه شدن هزینهها در بسیاری از بخشهای مختلف جامعه کمک کند. از جمله مهمترین کاربردهای دیپ لرنینگ عبارتاند از:

محصولات دارویی و پزشکی

کشف دارو و پیشبینی اثرات دارویی، نظارت بر مصرف دارو و شناسایی عوارض جانبی آن و تجویز داروی دقیق بر اساس روشهای درمانی مبتنی بر عوامل ژنتیکی، محیطی یا سبک زندگی.

بیمه

مکانیزه کردن شکایات و تجزیهوتحلیل خسارت از گزارشها یا تصاویر.

پیشبینی خطرات مبتنی بر تصویر برای بیمۀ خانه.

محاسبه قیمت برای تعیین حق بیمه.

خودرو

توسعۀ خودروهای بدون سرنشین

مدلهای یادگیری عمیق بیشماری در دوربینها و دستگاههای مورد استفاده در صنایع حملونقل استفاده میشود ازجمله مواردی برای تشخیص علائم راهنماییورانندگی، وسایل نقلیه دیگر، عابران پیاده و غیره.

خدمات مالی

معاملات: تخمین قیمتهای آینده بازار سهام.

تشخیص تقلب: شناسایی فعالیتهای کلاهبرداری با دقت بالاتر و مثبت کاذب کمتر.

سنجش اعتبار مشتری با تجزیهوتحلیل اطلاعات از چندین منبع و پاسخ سریعتر به درخواستهای وام.

مراقبتهای بهداشتی

تشخیص بیماریها با استفاده از راهحلهای تصویربرداری پزشکی، بهعنوانمثال شناسایی ضایعات سرطانی بالقوه در تصاویر رادیولوژی.

شخصیسازی درمانهای پزشکی

تعیین بیماران در معرض خطر در سیستم مراقبتهای بهداشتی.

هوا فضا و دفاع

شناسایی اشیاء بهدستآمده از ماهواره

تشخیص وقایع مشکوک یا جمعآوری اطلاعات از دوربینهای نظارتی.

کشاورزی

با استفاده از دادههای حسگرها و ماهوارهها با درنظرگرفتن دما، رطوبت و غیره، تولید عملکرد را بهینه میکند.

ساخت و تولید

شرکتهای تولیدی ازجمله تولیدات گسسته مانند خودرو یا سایر شرکتهای صنعتی (بهعنوانمثال نفت و گاز) به دلایل زیر به الگوریتمهای یادگیریعمیق اعتماد میکنند:

- ارائۀ ابزارهای پیشرفته تجزیهوتحلیل برای پردازش دادههای بزرگ درمورد تولید.

- ایجاد هشدارهای خودکار با استفاده از دادههای حسگر درمورد مسائل خطوط تولید بهعنوانمثال درمورد تضمین کیفیت یا ایمنی (بهمنظور اطلاعرسانی بهموقع به تیمهای مرتبط).

- خطوط بازرسی فنی، بازرسی کیفی، کنترل بستهبندی و …

- حمایت از سیستمهای تعمیرات قابل پیشبینی با استفاده از تجزیهوتحلیل تصاویر و سایر دادههای حسگر.

- توانمندسازی رباتهای صنعتی با حسگرها و مهارتهای بینایی رایانهای (کامپیوتری).

- کنترل محیط کار اطراف ماشینآلات سنگین به طور خودکار تا این اطمینان حاصل شود که افراد و اقلام در یک فاصله ایمن قرار دارند.

کاربرد دیپ لرنینگ به روایت تصویر

Classification

Assembly Verification

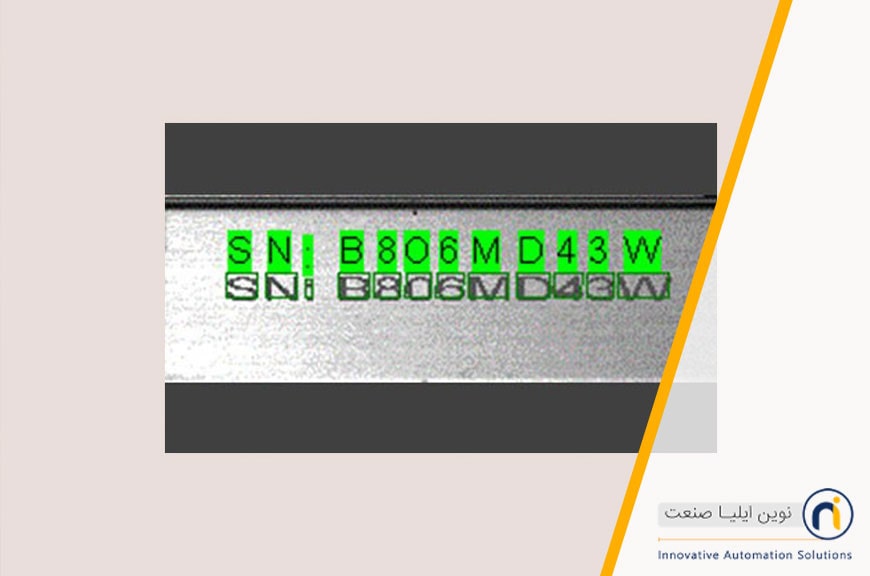

OCR

Defect Detection

Automotive

بازرسی درز جوش

خواندن کد بلوک موتور

تایید لبه چرخ

تشخیص عیب روکش صندلی

Electronics

بازرسی اتصال دستگاه تلفن همراه

خواندن کد باتری

مونتاژ PCB

تشخیص عیب صفحه نمایش شیشه ای

Packaging

بازرسی اتصال دستگاه تلفن همراه

بازرسی برچسب

تایید کیت آرایش

شناسایی برش گوشت

Miscellaneous Industries

بازرسی ماسک N95

چاپ کد روی تخم مرغ

مونتاژ کیت پزشکی

شناسایی نوع بسته بندی لجستیکی

مدلهای یادگیری عمیق

مدلهای یادگیری عمیق به مدل مولد، مدل افتراقی و مدل ترکیبی تقسیم میشود.

مدل افتراقی

مدل افتراقی، مرز تصمیمگیری بین گونهها را شکل میدهد و توزیع احتمال شرطی را میآموزد.

مدلهای مولد عمیق

مدلهای مولد عمیق یا (DGM) شبکههای عصبی با بسیاری از لایههای پنهان آموزش دیده برای تقریب توزیعهای احتمال پیچیده هستند. میتوانیم از DGMها برای تخمین احتمال هر مشاهده و ایجاد نمونههای جدید از توزیع اساسی استفاده کنیم.

مدل ترکیبی

رویکرد ترکیبی یک شبکه عصبی عمیق پیچیده برای تجزیهوتحلیل همکاری، حفظ حریم خصوصی است. برای این منظور، بهجای انجام کل عملیات روی فضای ابری، به اینترنت اشیاء اجازه میدهیم تا لایههای اولیه شبکه عصبی را اجرا کند و سپس خروجی را به فضای ابری ارسال میکند تا لایههای باقیمانده را تغذیه کند و نتیجه نهایی را تولید کند.

کاربرد های دیپ لرنینگ

دیپ لرنینگ در موارد متعددی کاربرد دارد و در حوزههای گوناگون از جمله هوش مصنوعی، تصویربرداری، پردازش زبان طبیعی، پزشکی، مالی، بازیابی اطلاعات، و صنعت به کار میرود. در زیر به برخی از کاربردهای اصلی دیپ لرنینگ اشاره شده است:

تصویربرداری و تشخیص تصویر

دیپ لرنینگ در تشخیص اشیاء، تفکیک الگوها، تشخیص چهره، و حل مسائل تصویربرداری مانند تشخیص اشیاء در تصاویر پزشکی یا خودروهای خودران استفاده میشود.

پردازش زبان طبیعی

در حوزه پردازش زبان طبیعی، دیپ لرنینگ برای ترجمه ماشینی، تولید متن، تحلیل سینتاکس و سامانهبندی اطلاعات متنی مورد استفاده قرار میگیرد.

بازشناسی صوت

در بخش بازشناسی صوت، دیپ لرنینگ میتواند برای تشخیص و تفسیر گفتار، تبدیل گفتار به متن، و سیستمهای خودکار تشخیص صداها استفاده شود.

پزشکی

در زمینه پزشکی، دیپ لرنینگ برای تشخیص بیماریها از تصاویر پزشکی، تخمین پیشبینی پیشروندگی بیماریها، پیشبینی نتایج درمان، و هوش تصمیمگیری در پزشکی به کار میرود.

مالی و بورس

در صنعت مالی، دیپ لرنینگ به تحلیل رفتار بازار، پیشبینی قیمتها، مدیریت ریسک، و شناسایی الگوهای مالی کمک میکند.

بازیابی اطلاعات و موتورهای جستجو

در موتورهای جستجو و بازیابی اطلاعات، دیپ لرنینگ به تحلیل محتوا، شناسایی اطلاعات مرتبط با جستجو، و بهبود دقت جستجوی اطلاعات کمک میکند.

صنعت و مهندسی

در حوزه صنعت و مهندسی، دیپ لرنینگ میتواند برای پیشبینی خرابی ماشینآلات، بهینهسازی فرآیندهای تولید، کنترل کیفیت، و تشخیص خطاها در سیستمهای صنعتی استفاده شود.

خودروهای هوشمند

در توسعه خودروهای هوشمند و خودروهای خودران، دیپ لرنینگ برای تشخیص محیط، شناسایی علائم رانندگی، و اتخاذ تصمیمات خودکار مورد استفاده قرار میگیرد.

پیشبینی و تحلیل اطلاعات

در بسیاری از حوزهها، از جمله مالیات، تجارت الکترونیک، و حتی سیاست، دیپ لرنینگ برای پیشبینی رویدادها، تحلیل دادهها، و ارائه پیشنهادات میتواند مفید باشد.

چالشها و افقهای آینده دیپ لرنینگ

با وجود پیشرفتهای چشمگیر در معماریهای شبکههای عصبی عمیق، همچنان موانعی چون نیاز به حجم بسیار بالای دادههای برچسبخورده و هزینههای محاسباتی سنگین پابرجا هستند. علاوه بر این، مشکلاتی در تفسیر و توضیح تصمیمات مدلهای پیچیده دیپ لرنینگ وجود دارد که منجر به محدودیت اعتماد در کاربردهای حساس مانند پزشکی و خودرانها میشود. تحقیقات اخیر روی یادگیری انتقالی و یادگیری بدون نیاز به نظارت سعی دارند میزان وابستگی به دادههای برچسبخورده را کاهش دهند و اثربخشی مدلها را در شرایط متغیر افزایش دهند. از سوی دیگر، ملاحظات اخلاقی و امنیتی—شامل مقابله با حملات دستکاری ورودیها و تضمین عدم تبعیض در پیشبینیهای مدل—باید همراه با توسعه فناوری مورد توجه قرار گیرد. در نهایت، ترکیب دیپ لرنینگ با حوزههای دیگر هوش مصنوعی مانند یادگیری تقویتی و پردازش زبان طبیعی پیشبینی میشود افقهای نوینی در اتوماسیون و تحلیل داده خلق کند.

مزایای استفاده از دیپ لرنینگ

استفاده از دیپ لرنینگ در حوزههای مختلف به مزایای فراوانی منجر شده است. در زیر به برخی از مزایای اصلی استفاده از دیپ لرنینگ اشاره شده است:

توانایی یادگیری از دادههای بزرگ

دیپ لرنینگ به خوبی با دادههای حجیم و پیچیده سازگاری دارد. این توانایی به مدلها این امکان را میدهد که اطلاعات عمیقتر و با کیفیتتری را از دادهها استخراج کنند.

یادگیری سلسله مراتبی و نمایشهای پیچیده

با استفاده از شبکههای عصبی عمیق، دیپ لرنینگ قادر به یادگیری سلسله مراتبی اطلاعات از دادهها است. این امکان باعث تولید نمایشهای پیچیدهتر و مفیدتر از دادهها میشود.

عملکرد بهتر در مسائل پیچیده

برخلاف روشهای سنتی یادگیری ماشینی، دیپ لرنینگ معمولاً در مواجهه با مسائل پیچیدهتر و وظایف متنوع به عملکرد بهتری دست مییابد. این امکان به تشخیص الگوهای پیچیده و ارتباطات مختلف در دادهها ارتقاء میبخشد.

توانایی انتقال یادگیری

مدلهای دیپ لرنینگ معمولاً توانایی انتقال یادگیری به وظایف مشابه را دارا هستند. این به این معناست که یک مدل آموزش دیده برای یک وظیفه میتواند به سرعت و با دقت بالا برای وظایف مشابه آموزش داده شود.

تعمیمپذیری و توسعهپذیری

مدلهای دیپ لرنینگ تعمیمپذیری بالایی دارند، به این معنا که میتوانند به راحتی به مسائل جدید و موارد مختلف توسعه یابند. این ویژگی موجب تسهیل در توسعه و استفاده از این مدلها در زمینههای مختلف میشود.

کاهش نیاز به ویژگیهای دستی

در مقایسه با بسیاری از روشهای یادگیری ماشینی مبتنی بر ویژگی، دیپ لرنینگ به نحوی است که نیاز به تعیین دقیق ویژگیهای دستی از سوی انسان را کاهش داده و به مدل اجازه میدهد که ویژگیهای مهم را از دادهها خود یاد بگیرد.

پیشرفت در حوزههای حساس به زمان

در بسیاری از حوزهها مانند پردازش زبان طبیعی، تصویربرداری پزشکی، و خودروهای خودران، دیپ لرنینگ بهبودهای چشمگیری در عملکرد و دقت به دنبال داشته است.

توانایی در حل مسائل چندمعیاره

دیپ لرنینگ به دلیل توانایی یادگیری از دادههای متنوع و حجیم، در حل مسائل چندمعیاره که اطلاعات مختلف و متنوعی دربر میگیرند، موثر و عالی عمل میکند.

بهبود عملکرد در تشخیص الگو

دیپ لرنینگ بهبود قابل توجهی در تشخیص الگوها و ارتباطات مختلف در دادهها داشته و در بسیاری از وظایف تصویربرداری، صوتی، و زبانی به عملکرد بهتری دست یافته است.

مثالی از تفاوت در تعاریف یادگیری عمیق (دیپ لرنینگ) و یادگیری ماشین

تعریف یادگیری ماشین

یادگیری ماشین یک زیرشاخه از هوش مصنوعی است که بر روی توسعه الگوریتمها تمرکز دارد که به مدلها این امکان را میدهد تا از دادههای آموزش یاد بگیرند و بتوانند پیشبینیها یا تصمیمگیریهایی را بر روی دادههای تازه اعمال کنند.

تعریف یادگیری عمیق

یادگیری عمیق یک زیرشاخه خاص از یادگیری ماشین است که بر روی استفاده از شبکههای عصبی عمیق تمرکز دارد. این شبکهها با ساختار لایههای عمیق و پیچیده به تحلیل دقیقتر و بازنمایی عمیقتر دادهها میپردازند.

مثالی از تفاوت در نمایش داده یادگیری عمیق (دیپ لرنینگ) و یادگیری ماشین

نمایش داده در یادگیری ماشین

در یادگیری ماشین، نمایش دادهها و ویژگیها معمولاً توسط انسان یا به شکل خودکار با استفاده از الگوریتمهای معین تعیین میشود. به عبارت دیگر، مهندسان ویژگیهای مهم را انتخاب میکنند.

نمایش داده در یادگیری عمیق

در یادگیری عمیق، شبکههای عصبی عمیق قادر به یادگیری نمایش دادهها بدون نیاز به انتخاب دستی ویژگیها هستند. این شبکهها به توانایی یادگیری اتوماتیک و بهصورت سلسلهمراتبی از ویژگیها مشهور هستند.

مثالی از تفاوت در تعداد دادهها یادگیری عمیق (دیپ لرنینگ) و یادگیری ماشین

تعداد دادهها در یادگیری ماشین

یکی از چالشهای یادگیری ماشین، نیاز به دادههای آموزش بزرگ برای دقت و کارایی مناسب مدلهاست.

تعداد دادهها در یادگیری عمیق

شبکههای عمیق به عنوان یک نقطه قوت، معمولاً با دادههای بزرگتر بهبود عملکرد دارند. این شبکهها به عنوان یک چشم مصنوعی بزرگ، توانایی استخراج الگوهای پیچیده و انتقال یادگیری را دارند.

مثالی از تفاوت در پیچیدگی مدل یادگیری عمیق (دیپ لرنینگ) و یادگیری ماشین

تعداد دادهها در یادگیری ماشین

مدلهای یادگیری ماشین معمولاً از پیچیدگی مدلهای کمتری برخوردارند و از الگوریتمهای سادهتری برای یادگیری از دادهها استفاده میکنند.

تعداد دادهها در یادگیری عمیق

شبکههای عمیق به دلیل ساختار پیچیدهتر لایهها و اتصالات، معمولاً پیچیدگی مدل بیشتری دارند. این پیچیدگی میتواند به تحلیل و استخراج اطلاعات پیچیدهتر از دادهها کمک کند.

مثالی از تفاوت یادگیری عمیق و یادگیری ماشینی

بیایید به مثالی در مورد چراغقوه بیندیشیم: این وسیله میتواند بهگونهای برنامهریزی شود تا وقتی شخصی کلمۀ «تاریک» را میگوید، روشن شود. با ادامه یادگیری، ممکن است در نهایت با هر عبارتی که حاوی آن کلمه است روشن شود. حال اگر چراغقوه مدل یادگیری عمیقی داشته باشد، متوجه میشود که باید با عباراتی چون «نمیتوانم ببینم» یا «کلید برق کار نمیکند» و شاید همزمان با یک حسگر نور هم روشن شود. یک مدل یادگیری عمیق قادر به یادگیری از طریق روش محاسبه خود است – روشی که باعث میشود طوری وانمود کند که گویی مانند انسان درک دارد.

برای بیان تفاوتهای این دو همین موارد بس که بگوییم:

- یادگیری ماشینی از الگوریتمها برای تجزیه دادهها، یادگیری از آن دادهها و تصمیمگیری آگاهانه بر اساس آموختههای خود استفاده میکند.

- یادگیری عمیق الگوریتمهایی بهصورت لایهلایه ایجاد میکند تا «شبکه عصبی مصنوعیای» بسازد که بتواند بهتنهایی یاد بگیرد و هوشمندانه تصمیم بگیرد.

- یادگیریعمیق زیرمجموعۀ یادگیری ماشین است. درحالیکه هر دو زیرمجموعهای از هوش مصنوعی هستند، یادگیری عمیق بیشترین شباهت را به هوش مصنوعی همانند انسان دارد.

تفاوت بین شبکههای عصبی و دیپ لرنینگ

ازآنجاکه شبکههای عصبی و یادگیری عمیق بسیار عمیق درهمآمیختهاند، تشخیص آنها از یکدیگر در سطح ظاهری دشوار است. درحالیکه شبکههای عصبی از سلولهای عصبی برای انتقال دادهها به شکل مقادیر ورودی و مقادیر خروجی از طریق اتصالات استفاده میکنند، یادگیریعمیق با تغییر شکل و استخراج ویژگیای همراه است که سعی در ایجاد ارتباط بین محرکها و پاسخهای عصبی مرتبط در مغز دارد.

چالشها و روندهای آینده در یادگیری عمیق

با وجود پیشرفتهای چشمگیر در کاربردهای عملی و تحقیقاتی، یادگیری عمیق همچنان با چالشهای مهمی مواجه است که برای حل آنها نیاز به تلاشهای مشترک جامعهی علمی و صنعت وجود دارد:

۱. نیاز به دادههای بسیار بزرگ و با کیفیت بالا

مدلهای دیپلرنینگ برای تولید نتایج قابل اعتماد به مجموعهدادههای کمّی و کیفی گسترده نیاز دارند. در بسیاری از حوزهها (مثلاً تشخیص بیماریهای نادر یا تحلیل تصاویر ماهوارهای در مناطق کمداده) تأمین مجموعهدادههای برچسبخورده و متنوع دشوار است. یکی از روندهای آینده، توسعه روشهای خودنظارتی (self-supervised learning) و انتقال یادگیری (transfer learning) است که به مدلها اجازه میدهد با دادهی کمتر ولی متنوعتر، بازده نزدیک به حالت کاملاً نظارتشده داشته باشند.

۲. شفافیت و قابلتوضیحبودن (Explainability)

شبکههای عصبی عمیق بهعنوان «جعبه سیاه» شناخته میشوند؛ چرا که ساختار داخلی آنها برای انسان کمتر قابل تفسیر است. این مسئله در زمینههایی مانند پزشکی، حقوقی و مالی که نیاز به توضیح تصمیمها دارند، تبدیل به مانعی بزرگ شده است. یکی از رشتههای نوظهور، یادگیری عمیق قابلتوضیح (Explainable AI) است که با طراحی لایهها و مکانیزمهایی برای استخراج مهمترین ویژگیها و مراحل تصمیمگیری مدل، سعی در رفع این مشکل دارد.

۳. امنیت و مقاومسازی در برابر حملات خصمانه

حملات adversarial به نمونههای ورودی که با تغییرات کوچک ولی هدفمند قادر به فریب مدل هستند، نشان دادهاند که مدلهای دیپلرنینگ در برابر دستکاری دادهها آسیبپذیرند. پژوهشهای مرتبط با دفاع در برابر این حملات (adversarial defenses) و همچنین طراحی شبکههای مقاوم (robust networks) از مهمترین زمینههای تحقیقاتی در سالهای آتی خواهند بود.

۴. هزینههای محاسباتی و مصرف انرژی

آموزش و اجرای مدلهای بزرگ دیپلرنینگ نیازمند منابع محاسباتی فراوان و مصرف بالای انرژی است. با توجه به مسائل زیستمحیطی و هزینههای سرورها، طراحی معماریهای کممصرفتر (efficient architectures) و الگوریتمهای بهینهسازی انرژی یکی از اولویتهای صنعت خواهد بود. فناوریهایی مانند محاسبات نووارونگون (neuromorphic computing) و تراشههای تخصصی هوش مصنوعی (AI accelerators) در این راه کمک خواهند کرد.

۵. همگرایی با سایر رشتهها و کاربردهای بینرشتهای

روند بعدی در یادگیری عمیق، تلفیق آن با حوزههایی مانند اینترنت اشیاء (IoT)، پردازش لبه (Edge Computing) و زیستمحاسبات (Bioinformatics) است. بهعنوان مثال، پردازش لبه اجازه میدهد مدلها بهطور محلی و در دستگاههای محدود اجرا شوند و وابستگی به سرورها را کاهش دهند. همچنین، استفاده از دادههای ژنومی برای پیشبینی دقیقتر در حوزه پزشکی، افقهای جدیدی باز خواهد کرد.

۶. استانداردسازی و قوانین اخلاقی

با گسترش کاربردهای دیپلرنینگ در تصمیمگیریهای حساس (مثلاً استخدام، اعطای وام یا تشخیص بیماری)، نیاز به ایجاد چارچوبهای قانونی و اخلاقی است تا از تبعیض و سوءاستفاده جلوگیری شود. تدوین راهنماهای شفاف برای جمعآوری داده، توسعه مدل و ارائه خروجی منصفانه (fairness) از نکات حیاتی خواهد بود.

تفاوت یادگیری عمیق و یادگیری ماشین

یادگیری عمیق (Deep Learning) و یادگیری ماشین (Machine Learning) دو حوزه مهم در زمینه هوش مصنوعی هستند که با تفاوتهای مهمی در رویکردها و روشهای استفاده شده شناخته میشوند. در کل، یادگیری عمیق به عنوان یک زیرمجموعه از یادگیری ماشین توانسته است با پیشرفتهای خود در حوزههای مختلف از جمله تصویربرداری، پردازش زبان طبیعی، و بازیابی اطلاعات بهبودهای چشمگیری ایجاد کند و نقش اساسی در پیشرفتهای آینده در حوزه هوش مصنوعی ایفا خواهد کرد. در تعریفی دیگر، یادگیری عمیق و یادگیری ماشین دو دیدگاه متفاوت در زمینه هوش مصنوعی هستند که هرکدام ویژگیها و کاربردهای خاص خود را دارند.

به طور کلی، یادگیری عمیق بیشتر برای وظایف پیچیده و با دادههای بزرگ مناسب است، در حالی که یادگیری ماشین به طور کلی برای وظایف سادهتر و با دادههای کمتر مناسب است. اما هر دو این رویکردها در توسعه فناوریهای هوش مصنوعی و پیشرفتهای فناوری موثر و مفید هستند. در ادامه تفاوتهای اساسی بین این دو مفهوم مورد بررسی قرار میگیرد:

نرمافزارها و سختافزارهای مورده استفاده در دیپ لرنینگ

نرمافزارها

تنسور فلو Tensor Flow

این برنامه به یادگیری عمیق کمک شایانی میکند. این نوع داده، یک آرایۀ چندبعدی است و با استفاده از جعبه ابزار متنباز به یادگیری ماشین کمک میکند و میتوان با کمک آن سیستمهای قابل ارتقا ساخت.

پایتون

نرمافزار دیگری که در این زمینه میتوان استفاده کرد، نرمافزار پایتون است. بهمنظور کار با این نرمافزار لازم است که پایتون 2.7. روی سیستم خود نصب کنید. کتابخانههای نامپی Numpy، مَت پلات لیب Matplotlib، کِراس Keras و … نیز باید روی پایتون شما نصب شده باشد.

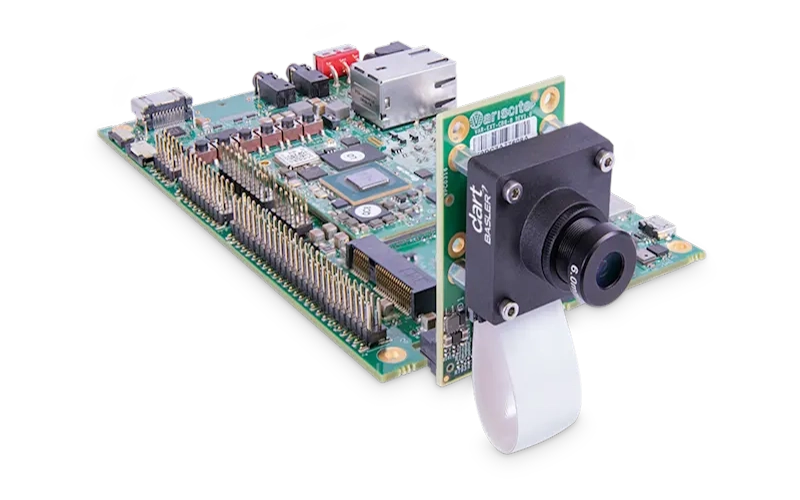

سختافزارها

پردازندۀ گرافیکیGPU

برای یادگیری عمیق به GPU نیاز خواهیم داشت. GPU قلب برنامههای یادگیریعمیق است و نقش آن را نمیتوان آن را نادیده گرفت. با استفاده از یک GPU میتوان زمان انجام آزمایشها را از چندین ماه به چند ساعت، از چند روز به چند ساعت و از چندین ساعت به چند دقیقه کاهش داد.

واحد منبع تغذیه (PSU)

PSU یا همان منبع تغذیه، دستگاهی است که انرژی مورد نیاز سختافرازهای یک سیستم بینایی ماشین را فراهم میکند. این دستگاه جریان متناوب ورودی را به جریان مستقیم قابل استفاده در قطعات کامپیوتر تبدیل میکند.

در پایان باید یادآور شد که دیپ لرنینگ «یادگیری عمیق» روزبهروز در حال گسترش و پیشرفت است و در اکثر تکنولوژیهای روز نیز قابلِاستفاده است. در این مورد البته باید مراقب تشخیص درست و غلطکار ماشین نیز باشیم. به طور مثال در یکی از زیرشاخههای آن به نام دیپفیک (Deep fake) بهراحتی عکس و صدای شخصی را میتوان بهجای شخصی دیگر قرار داد و این موضوع تبعات خودش را دارد. دیپ لرنینگ یکی از بازوهای مهم بینایی ماشین، یادگیری ماشین و علم هوش مصنوعی است.

پرسش و پاسخ و سوالات متداول درباره دیپ لرنینگ

دیپ لرنینگ چیست؟

دیپ لرنینگ یک حوزه از هوش مصنوعی است که بر روی توسعه مدلهای یادگیری عمیق متمرکز است. این مدلها از شبکههای عصبی با ساختارهای پیچیده برای یادگیری نمایشهای پویا و سلسله مراتبی از دادهها استفاده میکنند.

چه تفاوتی بین دیپ لرنینگ و یادگیری ماشینی معمولی وجود دارد؟

چه کاربردهایی برای دیپ لرنینگ وجود دارد؟

چگونه یک مدل دیپ لرنینگ آموزش داده میشود؟

آیا دیپ لرنینگ همیشه بهتر از یادگیری ماشینی معمولی است؟

چه چالشهایی در دیپ لرنینگ وجود دارد؟

آیا دیپ لرنینگ به حساسیت بیشتری به دادههای آموزش نسبت به یادگیری ماشینی معمولی دارد؟

آیا دیپ لرنینگ برای کاربردهایی که دادههای محدودی دارند مناسب است؟

آیا دیپ لرنینگ توسعه پذیری خوبی دارد؟

آیا دیپ لرنینگ در زمینههای خاصی مانند پزشکی و صنعت موثر است؟

در کدام حوزهها و صنایع از دیپ لرنینگ استفاده میشود؟

چه جایگاهی برای دیپ لرنینگ در آینده یادگیری ماشین پیشبینی میشود؟

چگونه الگوریتمهای یادگیری عمیق با استفاده از شبکههای عصبی پیچشی (CNN) به بهبود دقت شناسایی اشیاء در تصاویر کمک میکنند و چه تفاوتهایی با روشهای سنتی پردازش تصویر دارند؟

چگونه دیپ لرنینگ در بینایی ماشین و پردازش تصویر استفاده میشود؟

چرا دیپ لرنینگ در پردازش تصویر و بینایی ماشین کاربرد زیادی دارد؟

معروفترین فریمورکهای دیپ لرنینگ کداماند؟

GPU چرا برای دیپ لرنینگ مهم است؟

Overfitting در دیپ لرنینگ چیست و چگونه مقابله کنیم؟

Transfer Learning چیست؟

چه دیتاستهایی برای شروع کار وجود دارد؟

چگونه یک مدل دیپلرنینگ را به صورت عملی در یک محیط تولید (Production) مستقر کنیم؟

مسائل اخلاقی و تبعیض (Bias) در مدلهای دیپلرنینگ چه تأثیری میتواند داشته باشد؟

چه نکاتی در انتخاب سختافزار برای آموزش و استقرار مدل باید در نظر گرفت؟

بهینهسازی ابرپارامترها (Hyperparameter Tuning) چگونه انجام میشود؟

کدام مجموعهدادهها (Dataset) برای آزمایش و مقایسه مدلهای بینایی ماشین معمولاً استفاده میشوند؟

یادگیری دیپ لرنینگ چقدر طول میکشد؟

بهترین زبان برنامهنویسی برای دیپ لرنینگ چیست؟

آیا برای یادگیری دیپ لرنینگ به ریاضیات قوی نیاز داریم؟

تفاوت اصلی دیپ لرنینگ با هوش مصنوعی چیست؟

دیپ لرنینگ چه نقشی در تشخیص بیماریهای پزشکی دارد؟

چطور دیپ لرنینگ در صنعت خودروسازی استفاده میشود؟

کاربرد دیپ لرنینگ در کشاورزی چیست؟

آیا دیپ لرنینگ در امنیت و نظارت شهری استفاده میشود؟

آخرین مقالات درباره دیپ لرنینگ

کاربرد یادگیری عمیق در تشخیص اتوماتیک حروف روی صفحات فلزی

یادگیری عمیق چگونه بینایی ماشین را بهبود میبخشد؟

ماشینها و شبکههای عصبی چگونه یاد میگیرند؟